Big Data heißt: Riesige Datenmengen müssen verarbeitet werden. Die manuelle Auswertung stößt schnell an ihre Grenzen. Durch Visualisierung der Daten kann das Verfahren deutlich optimiert werden. Hierfür fehlt es jedoch häufig an einem geeigneten Medium, das in der Lage ist, alle Daten in ihrem Gesamtzusammenhang darstellen zu können und gleichzeitig eine Analyse von feinen Details erlaubt.

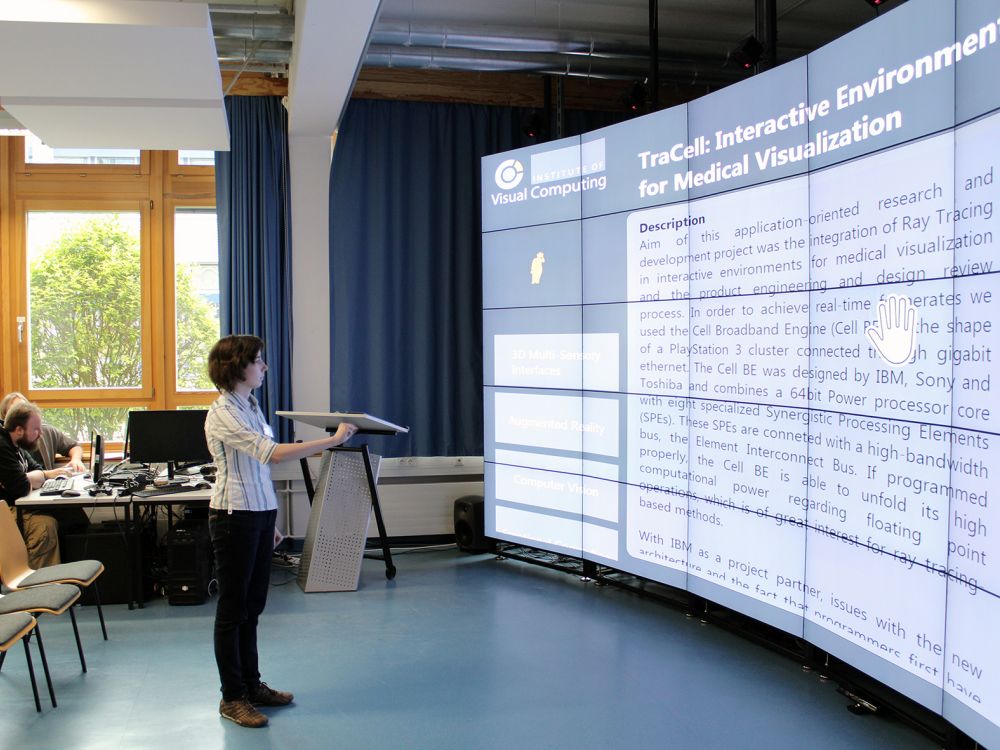

Um dieses Problem zu lösen, hat das Institut für Visual Computing der Hochschule Bonn-Rhein-Sieg in Sankt Augustin mit der HORNET eine der deutschlandweit größten interaktiven und ultrahochauflösenden Displaywände in Betrieb genommen. Sie besteht aus 35 steglosen Videowand-LCDs von Eyevis vom Typ EYE-LCD-4600-M-USN-LD mit einer Gesamtauflösung von 72 Megapixeln sowie einem dazugehörigen Workstation-Cluster. Die für die Video Wall verwendeten 46-Zöller haben jeweils eine Luminanz von 700 cd/m². Generalunternehmer für das ambitionierte Projekt war die imsys immersive systems GmbH & Co. KG, die auch das verwendete Tracking-System geliefert hat.

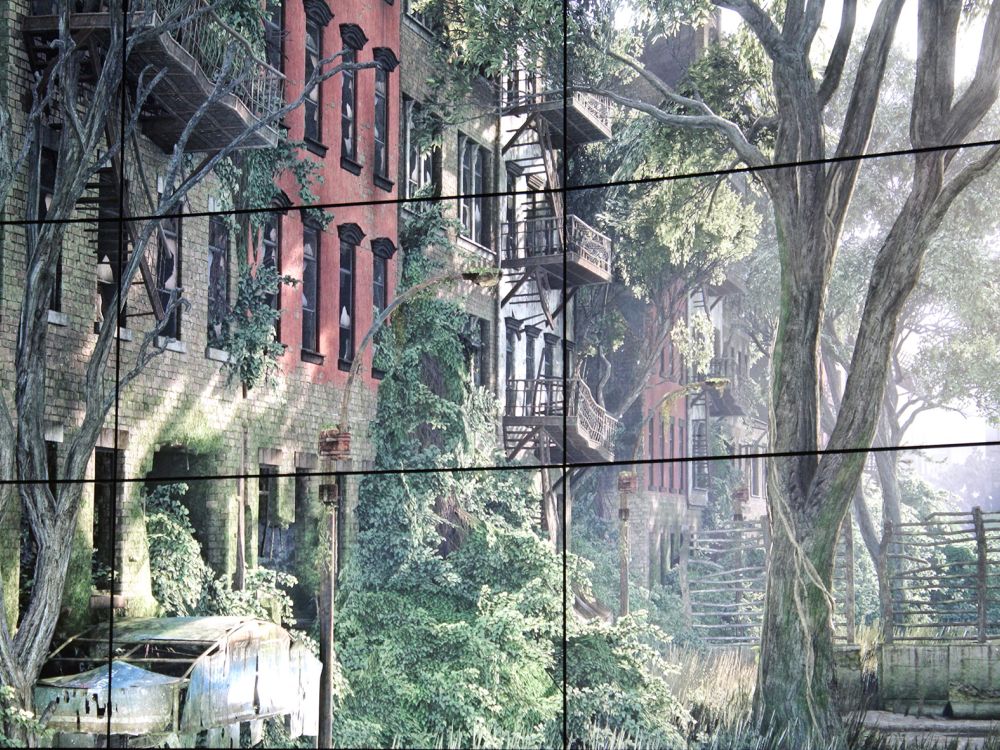

Mit HORNET kann beispielsweise in der Molekular-Forschung bei der Entwicklung neuer Medikamente das Zusammenspiel von Molekülen auf der untersten atomaren Ebene beobachtet und ausgewertet werden. Tritt der Betrachter einige Schritte von der Wand zurück, erhält er auf der Videowand eine Gesamtübersicht der Moleküle, ohne die Darstellung ändern zu müssen.

Rechenpower ohne Ende

Für die sinnvolle Visualisierung von Big Data ist zudem die schnelle Umrechnung der Daten in 3D-Grafiken und deren Berechnung in Echtzeit erforderlich. So nutzt das Institut ein softwarebasiertes, interaktives Echtzeitrendering dreidimensionaler Szenen und ein realistisches Rendering mit hoher Auflösung für die Darstellung. Um die nötige Rechenleistung für die Darstellung auf den Displays bereitzustellen, hat die Hochschule gemeinsam mit ProGraphics | Rolf Huwer Consulting drei Workstations mit jeweils drei Grafik-Karten und vier Full HD-Ausgängen pro Grafikkarte konfiguriert, die insgesamt 35 Full HD-Signale ausgeben. Die Synchronisierung der 35 Signale läuft ebenfalls softwarebasiert.

„Für die Darstellung komplexer Ergebnisse reicht diese Rechenleistung jedoch nicht aus. Um maßstäbliche Visualisierungen von Produkten etwa von Autos oder Industriemaschinen in hoher Qualität zu ermöglichen, werden die drei Computer mit einem Cluster von zwölf weiteren Rechnern verbunden. Diese verfügen jeweils über drei leistungsstarke Grafikkarten. Sie berechnen die anspruchsvollen Grafiken und senden sie an die drei Computer an der Displaywand. Um die notwendige Geschwindigkeit bei der Datenübertragung zu erreichen, haben wir zudem ein Netzwerk mit bis zu 60GBit/s Transferleistung aufgebaut“, sagt. Prof. Dr. André Hinkenjann, Direktor des Instituts für Visual Computing. Traditionell sei der Bildaufbau solch hochauflösender und hochqualitativer Grafiken im Minutenbereich angesiedelt. Mit der HORNET-Installation bewege man sich im Sekundenbereich.

Interaktive Steuer-Elemente

Für eine genauere Untersuchung der visualisierten Daten hält die Videowand zudem verschiedene interaktive Steuerungsmöglichkeiten bereit. So ermöglicht eine Xbox-Kinect-Kamera die Steuerung der Wand durch Gesten. Sieben Tracking-Kameras, die zusätzlich oberhalb der Videowand installiert sind, erfassen Nutzer, die vor der Wand stehen, über ein Tracking-System der ART – Advanced Realtime Tracking GmbH. Das System erkennt die Position und die Bewegungen der Nutzer vor der Videowand. So kann beispielsweise die Darstellung auf der Wand durch Handgesten gesteuert werden. Für eine 3D-Darstellung auf der monoskopischen Videowand passt das System zudem die Perspektive räumlicher Inhalte an die Position des Nutzers an. Dargestellte Objekte, die weiter entfernt sind, bewegen sich bei Perspektivenwechsel langsamer als nahe Objekte. Durch diesen – Bewegungsparallaxe genannten – Effekt entsteht beim Betrachter der 3D-Eindruck.